Documentation Index

Fetch the complete documentation index at: https://docs.evolink.ai/llms.txt

Use this file to discover all available pages before exploring further.

概述

OpenClaw 是一个开源的 AI 智能体 Gateway 网关,充当聊天应用与 AI 智能体之间的桥梁。通过一个中心化的 Gateway 进程,它可以将 Telegram、WhatsApp、Discord、飞书等聊天平台连接到 AI 编程智能体。 本文档介绍如何手动安装 OpenClaw 并配置 EvoLink API 作为模型提供商。完成本文档后,你可以继续配置具体的聊天渠道(如 Telegram 或飞书)。 本文将介绍:- 安装并配置 OpenClaw Gateway

- 将 EvoLink API 配置为自定义模型提供商

- 验证安装是否成功

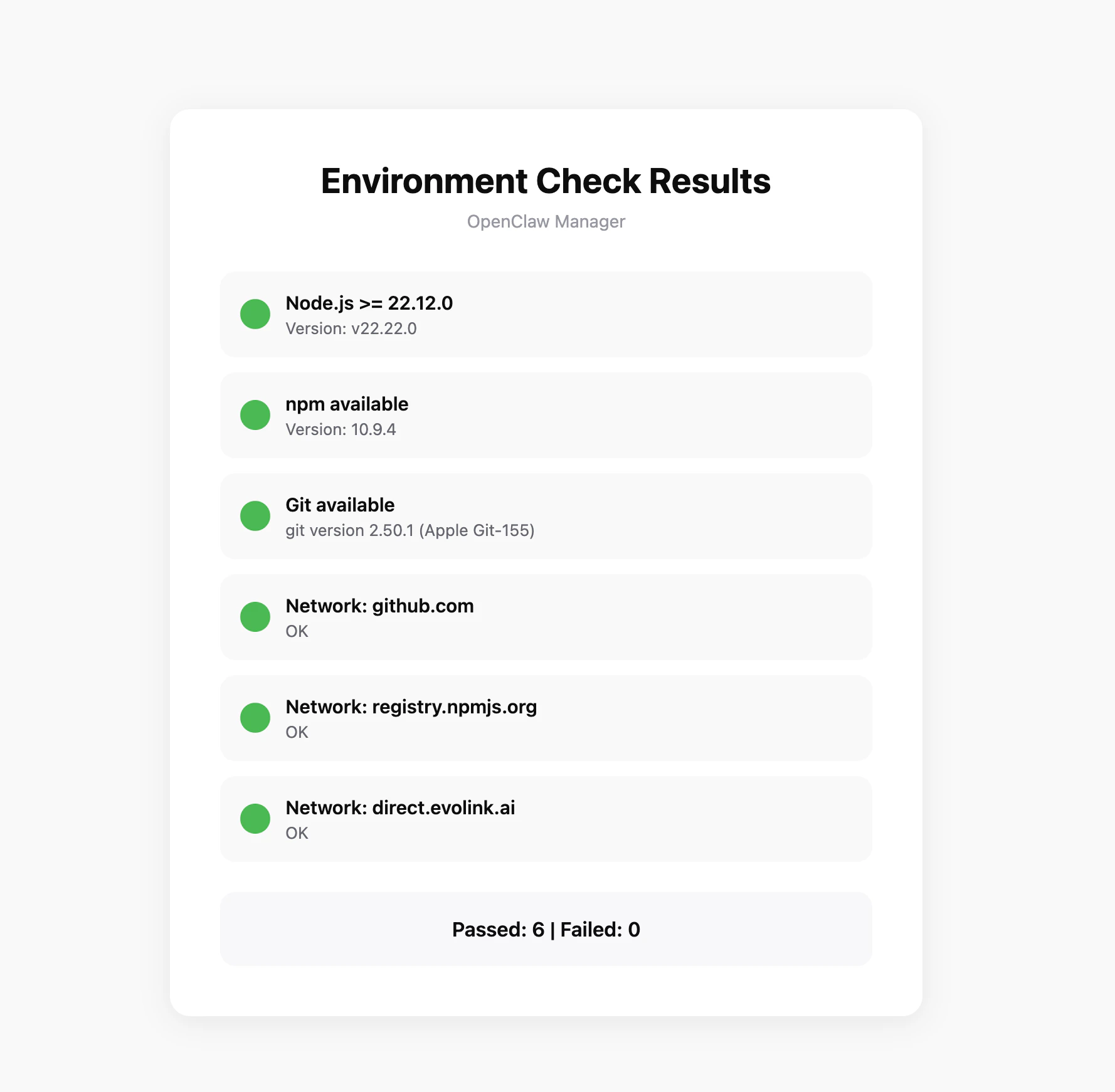

系统环境检查(可选)

在开始安装之前,建议先运行环境检查工具,确保你的系统满足 OpenClaw 的运行要求。下载检查工具

从 GitHub Releases 下载对应平台的检查工具:| 平台 | 文件名 |

|---|---|

| Windows | openclaw-checker-win-x64.exe |

| macOS (Intel) | openclaw-checker-macos-x64 |

| macOS (Apple Silicon) | openclaw-checker-macos-arm64 |

| Linux | openclaw-checker-linux-x64 |

检查项目

工具会自动检查以下条件:- ✅ Node.js 版本(需要 >= 22.12.0)

- ✅ npm 可用

- ✅ Git 可用

- ✅ 网络连通性(github.com、npmjs.org、evolink.ai)

使用前准备

在开始配置之前,请确保已完成以下准备工作:1. 安装 Node.js

OpenClaw 通过 npm 安装,需要先安装 Node.js 22 或更高版本。- Windows

- macOS

访问 Node.js 官网,下载 Windows 安装包(.msi 文件),双击运行安装程序。安装完成后,打开 PowerShell 验证:

建议以管理员身份运行 PowerShell,避免后续安装时出现权限问题。

2. 获取 EvoLink API Key

- 登录 EvoLink 控制台

- 在控制台中找到 API Keys,点击”创建新Key”按钮,然后复制生成的 Key

- API Key 通常以

sk-开头,请妥善保存

第一步:安装 OpenClaw

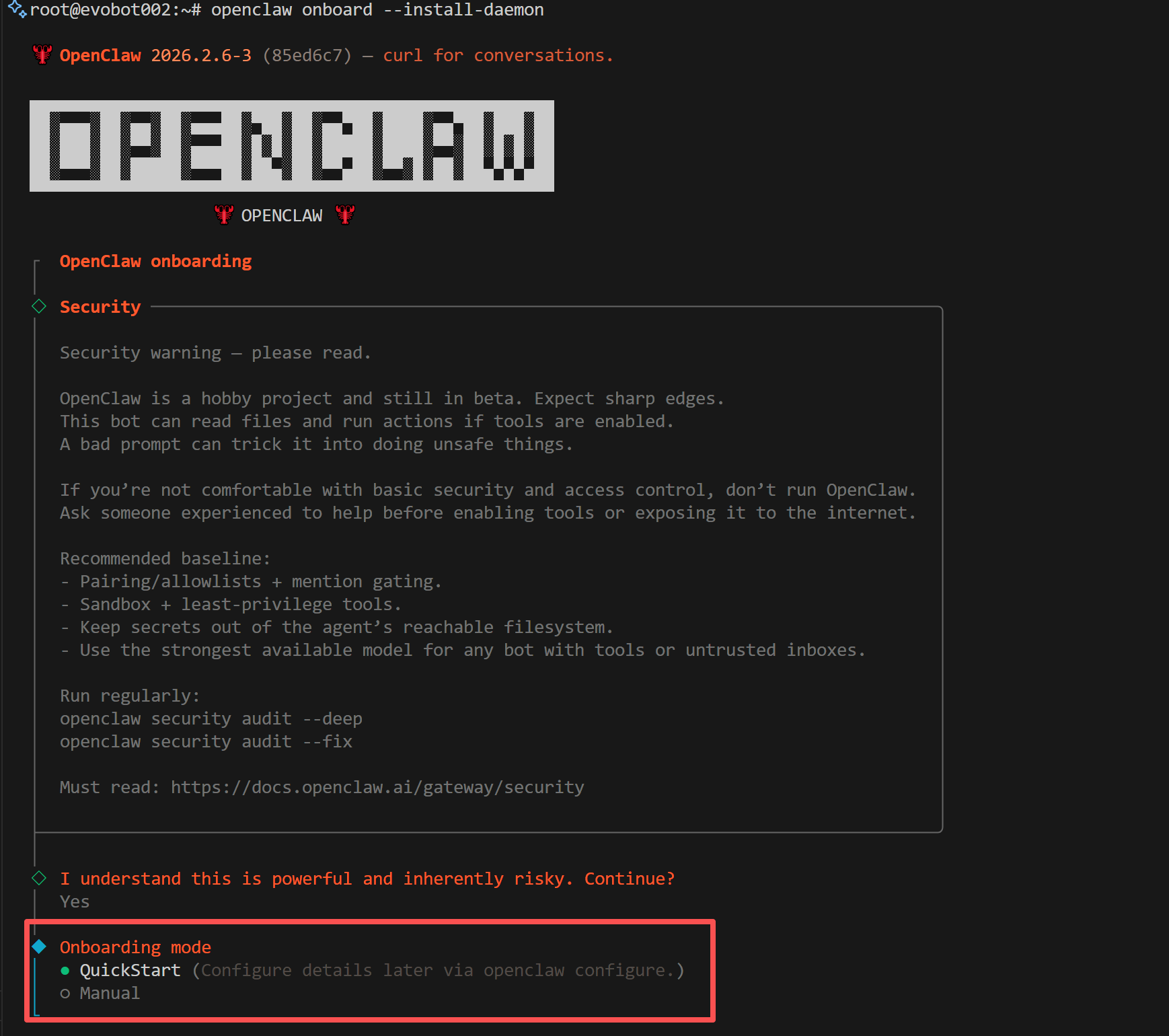

在终端中执行:第二步:初始化引导

运行新手引导命令,OpenClaw 会引导你完成初始配置并安装后台守护服务:1. 确认安装

系统会提示安装风险说明,确认同意后继续:

2. 选择安装模式

系统会提示选择安装模式,选择 Quickstart 即可:

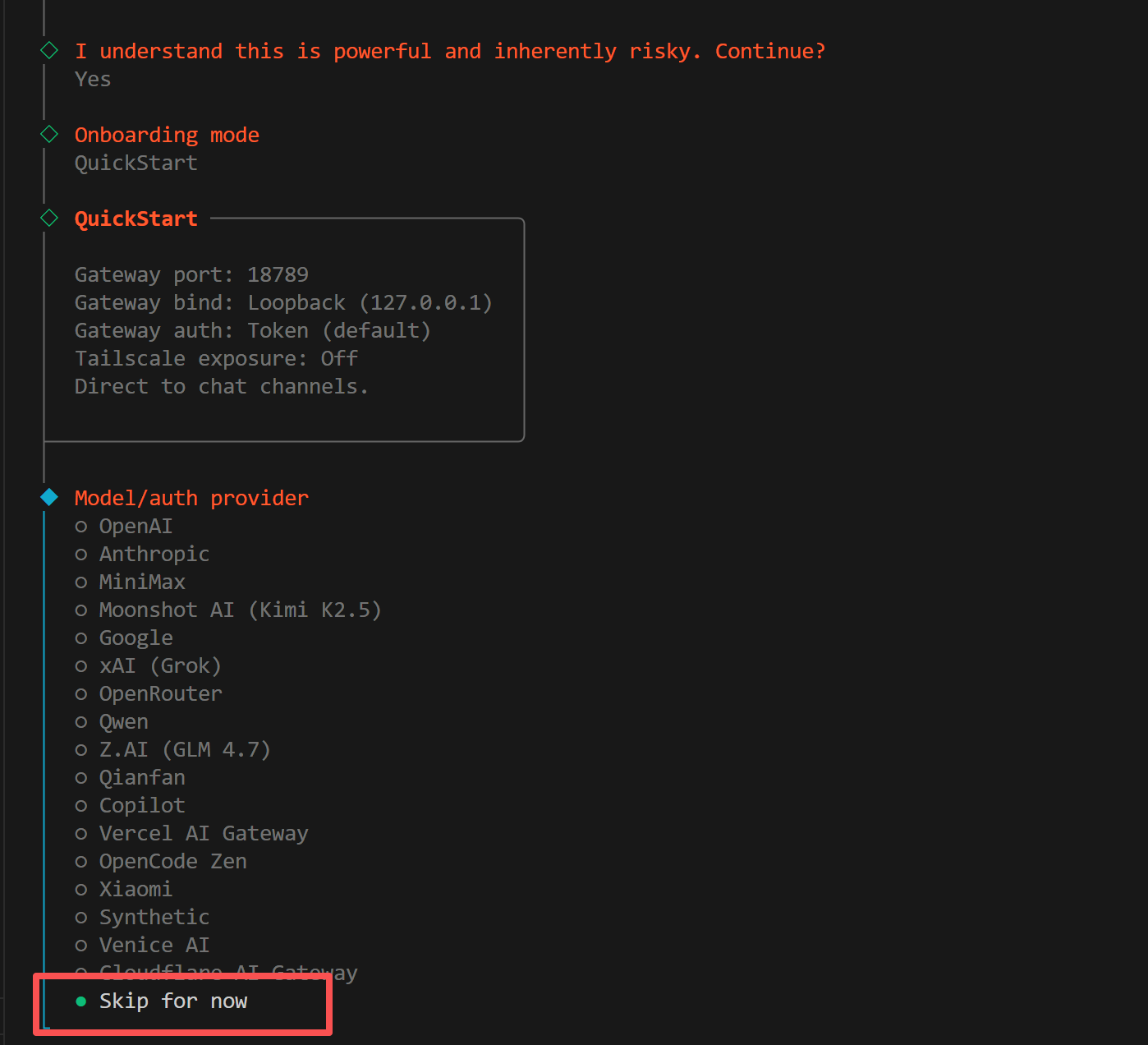

3. 选择供应商

系统会提示选择模型供应商,这里选择 跳过(Skip),后续我们会手动配置 EvoLink 作为自定义供应商:

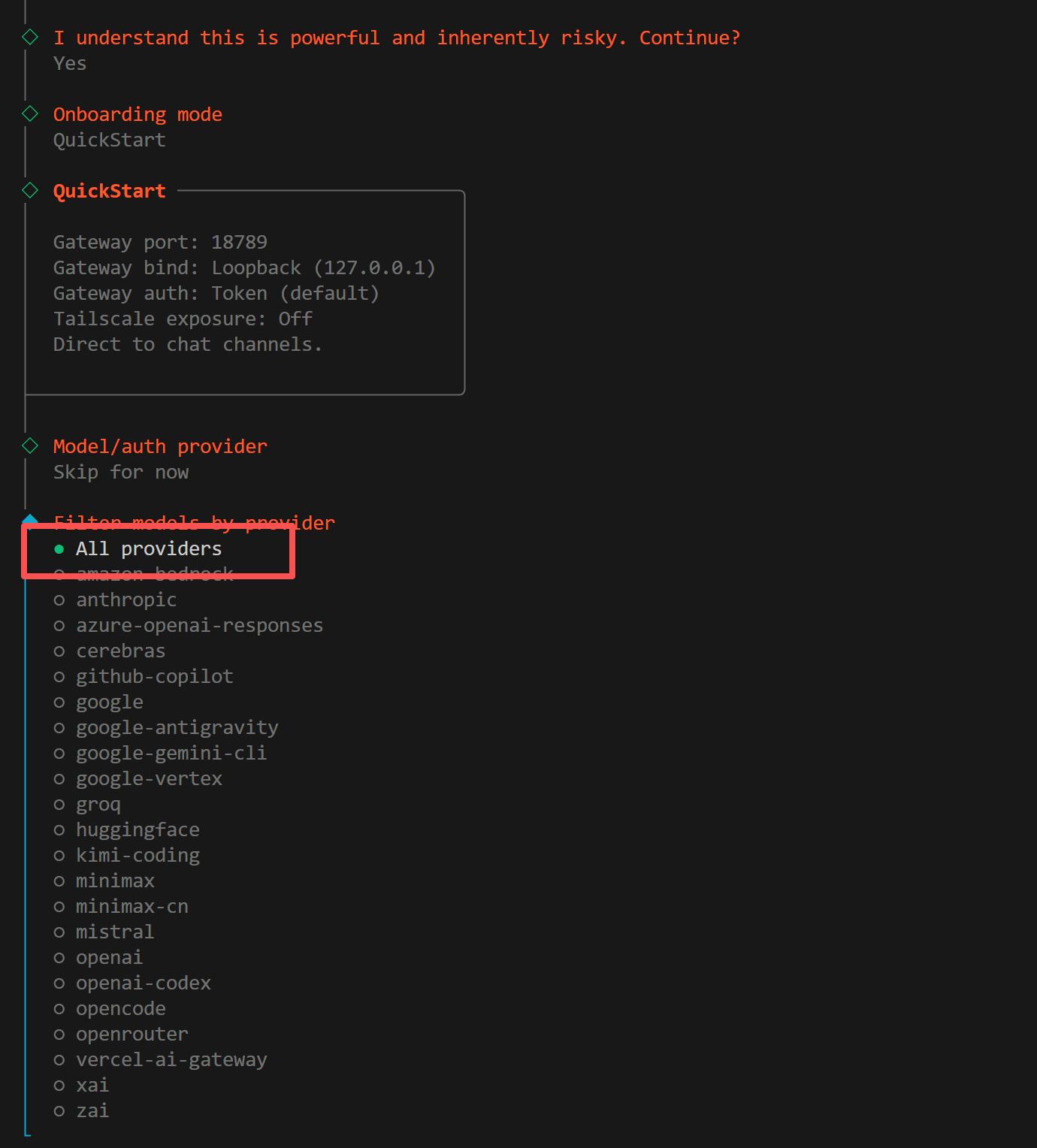

4. 选择模型

系统会提示选择要启用的模型,选择 All(全部) 即可:

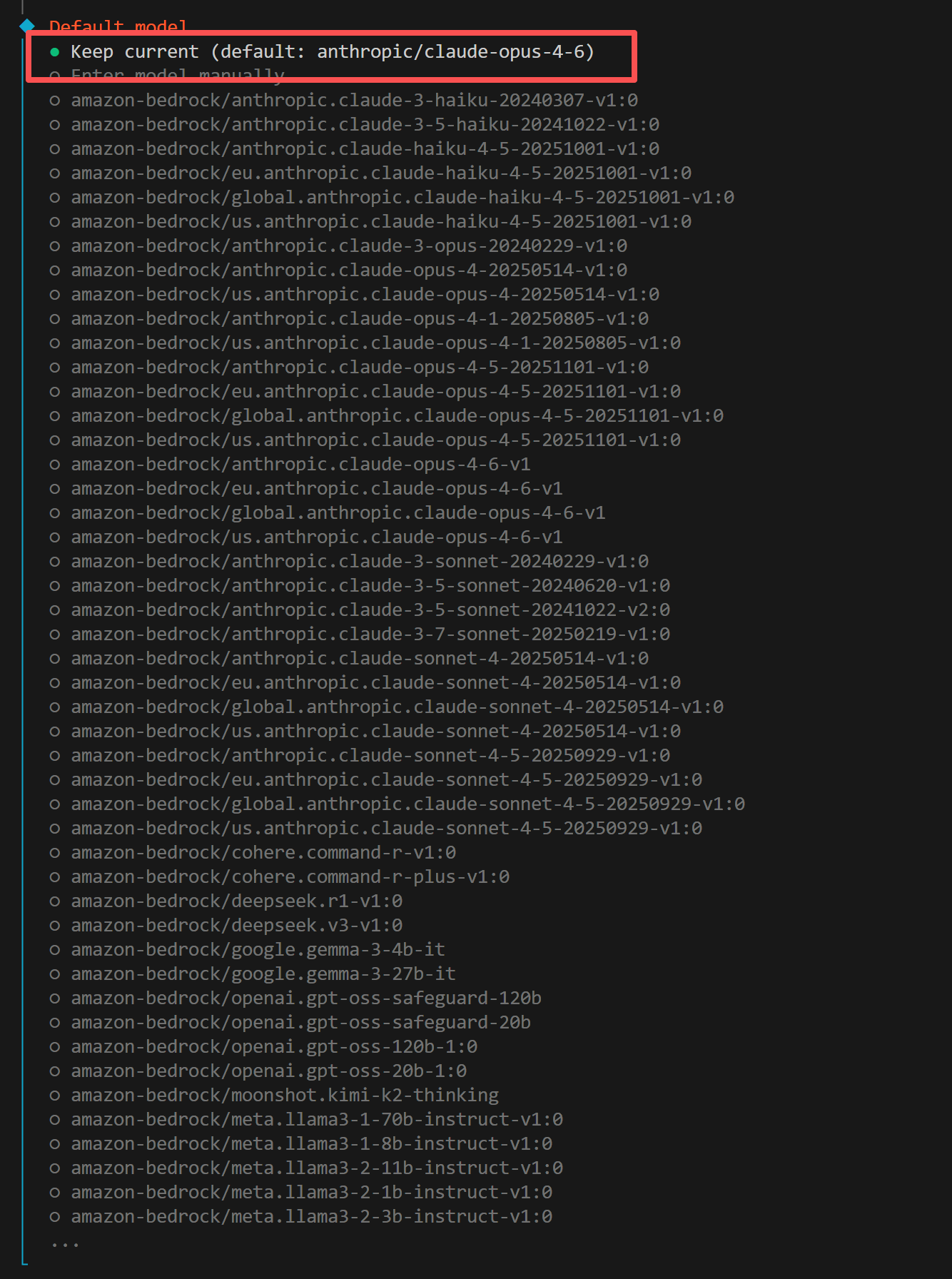

5. 选择默认模型

系统会提示选择默认模型,选择 Keep current(保持当前) 即可:

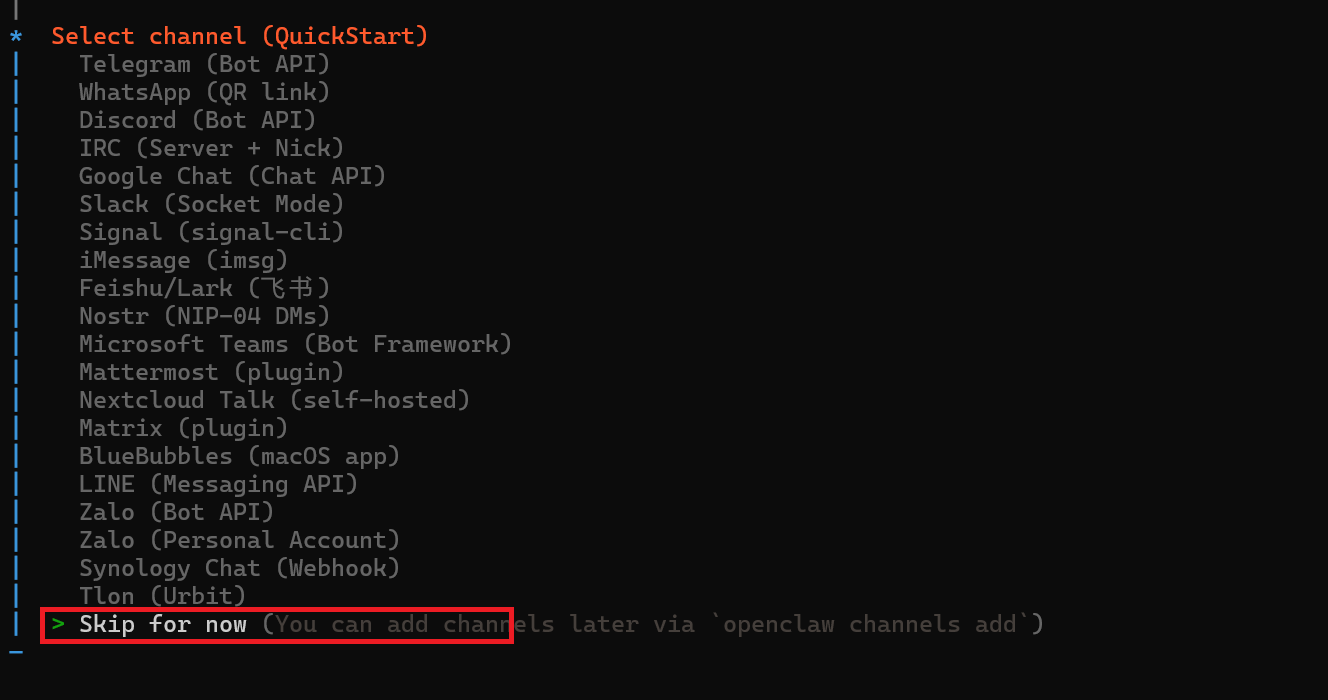

6. 选择渠道

系统会提示选择要配置的聊天渠道。这里建议选择 Skip for now(暂时跳过),以后可以随时添加渠道:

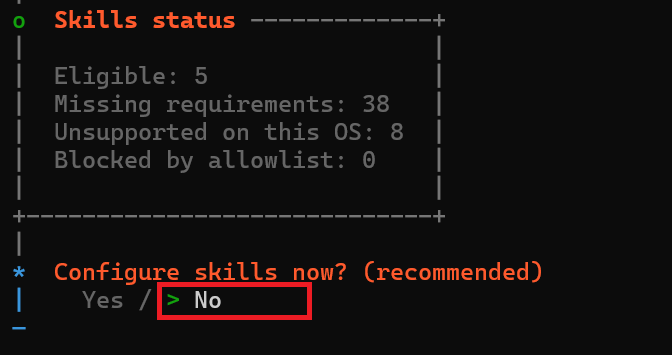

7. 配置 Skills

系统会提示是否配置 Skills。建议选择 No,以后可以随时添加:

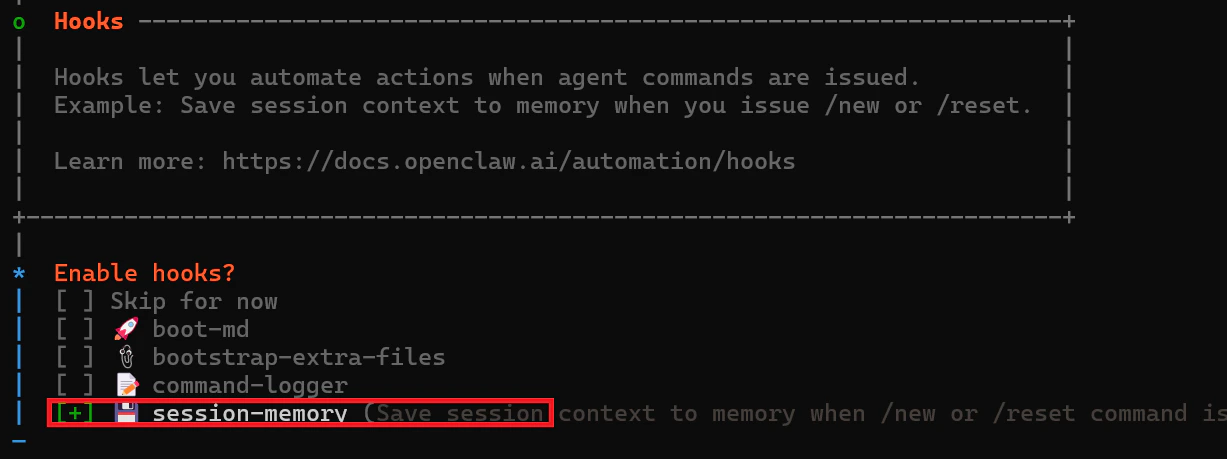

8. 启用 Hooks

系统会提示是否启用 Hooks。建议选择 session-memory:

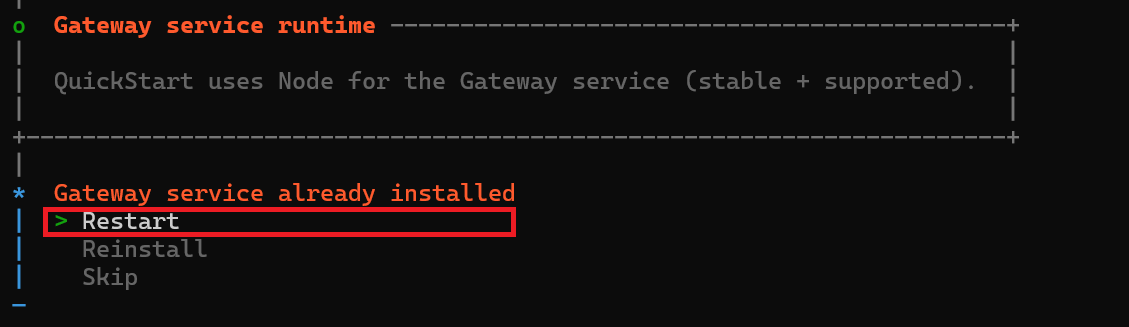

9. 重启网关服务

系统会提示网关服务已安装,选择 Restart(重启):

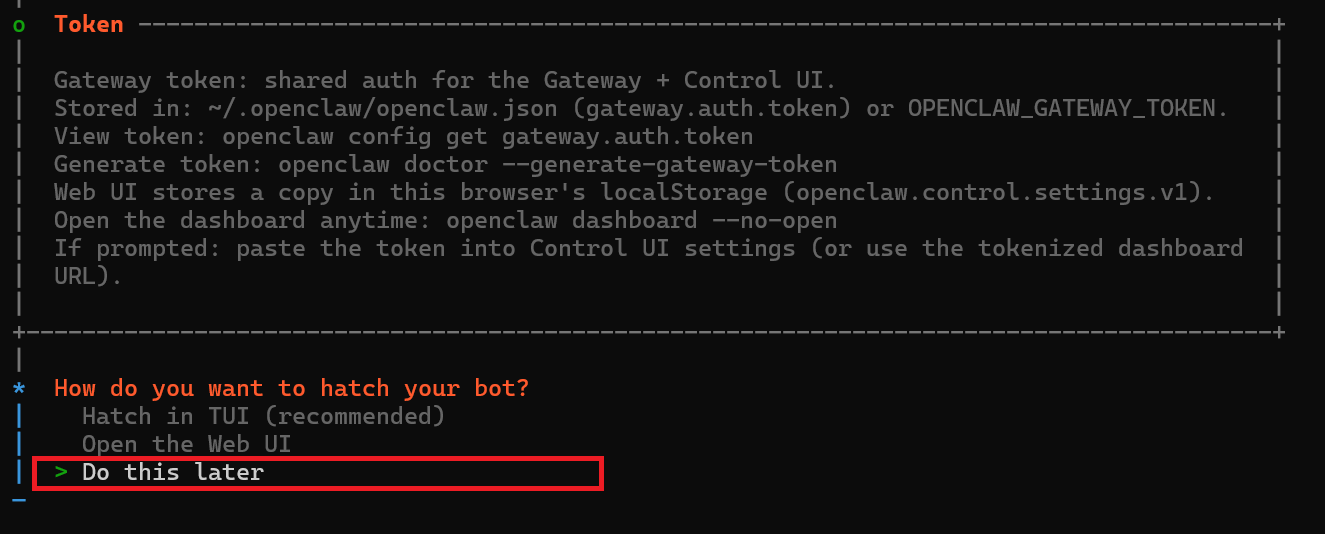

10. 启动机器人

系统会提示如何启动机器人。建议选择 Do this later(稍后处理):

第三步:配置 EvoLink API 与模型切换

1. 找到两个配置文件(重点)

OpenClaw 模型配置通常涉及两个文件:- Windows

- macOS

openclaw.json:%USERPROFILE%\\.openclaw\\openclaw.jsonmodels.json:%USERPROFILE%\\.openclaw\\agents\\main\\agent\\models.json

2. 配置模型提供商

建议在openclaw.json 中配置以下 providers(并同步到 models.json):

以上模型 ID 为示例。请以你的 EvoLink 账户实际开通模型为准。

3. 配置默认模型(支持快速切换)

在agents.defaults 中设置默认模型。推荐使用智能路由 evolink/auto,系统会根据请求自动选择合适的模型:

- 智能路由:

evolink-anthropic/evolink/auto(推荐) - Claude:

evolink-anthropic/claude-opus-4-6 - GPT:

evolink-openai/gpt-5.2 - Gemini:

evolink-google/gemini-3.1-pro-preview - Doubao:

evolink-openai/doubao-seed-2.0-mini

4. 快速切换到 EvoLink 模型(推荐)

完成 provider 配置后,后续切换模型建议直接用 CLI 命令,不必反复手改 JSON:如果

models list --provider evolink-openai 看不到你预期的模型,请先检查 openclaw.json 与 models.json 两处是否都已配置对应 provider。5. 重启并验证

配置完成后重启网关:常用命令

| 命令 | 描述 |

|---|---|

openclaw gateway status | 检查网关运行状态 |

openclaw gateway restart | 重启网关服务 |

openclaw gateway stop | 停止网关服务 |

openclaw gateway start | 启动网关服务 |

openclaw logs --follow | 实时查看网关日志 |

openclaw plugins list | 查看已安装的插件 |

故障排除

| 问题 | 排查方法 |

|---|---|

| npm 安装失败 | Windows: 以管理员身份运行 PowerShell; macOS: 在命令前加 sudo |

| 找不到配置文件 | 确认 onboard 流程已完成,检查 ~/.openclaw/ 目录是否存在 |

| 网关启动失败 | 检查端口是否被占用,使用 openclaw gateway status 查看详细错误 |

| API Key 无效 | 确认 API Key 正确复制,检查是否有多余空格或引号 |

| 模型配置不生效 | 同时检查 openclaw.json 与 models.json 是否一致(models.json 可能覆盖) |

Gemini 返回 Forbidden (403) | 检查 models.providers.evolink-google.baseUrl 是否为 https://direct.evolink.ai/v1beta(必须带 /v1beta) |

| 切换模型后仍使用旧模型 | 执行 openclaw models status --plain 确认当前模型,必要时 openclaw gateway restart |

下一步

OpenClaw 安装和 EvoLink API 配置已完成。接下来你可以:- 配置 Telegram 渠道: 参考 OpenClaw + Telegram 文档

- 配置飞书渠道: 参考 OpenClaw + 飞书 文档

- 使用自动安装工具: 参考 OpenClaw 自动安装 文档