Documentation Index

Fetch the complete documentation index at: https://docs.evolink.ai/llms.txt

Use this file to discover all available pages before exploring further.

Aperçu

OpenClaw est une passerelle d’agent IA open source qui agit comme un pont entre les applications de chat et les agents IA. Grâce à un processus de passerelle centralisé, il peut connecter des plateformes de chat comme Telegram, WhatsApp, Discord et Feishu aux agents de programmation IA. Ce document décrit comment installer manuellement OpenClaw et configurer EvoLink API comme fournisseur de modèles. Après avoir terminé ce document, vous pouvez continuer à configurer des canaux de chat spécifiques (comme Telegram ou Feishu). Ce guide couvre :- Installation et configuration d’OpenClaw Gateway

- Configuration d’EvoLink API comme fournisseur de modèles personnalisé

- Vérification de l’installation

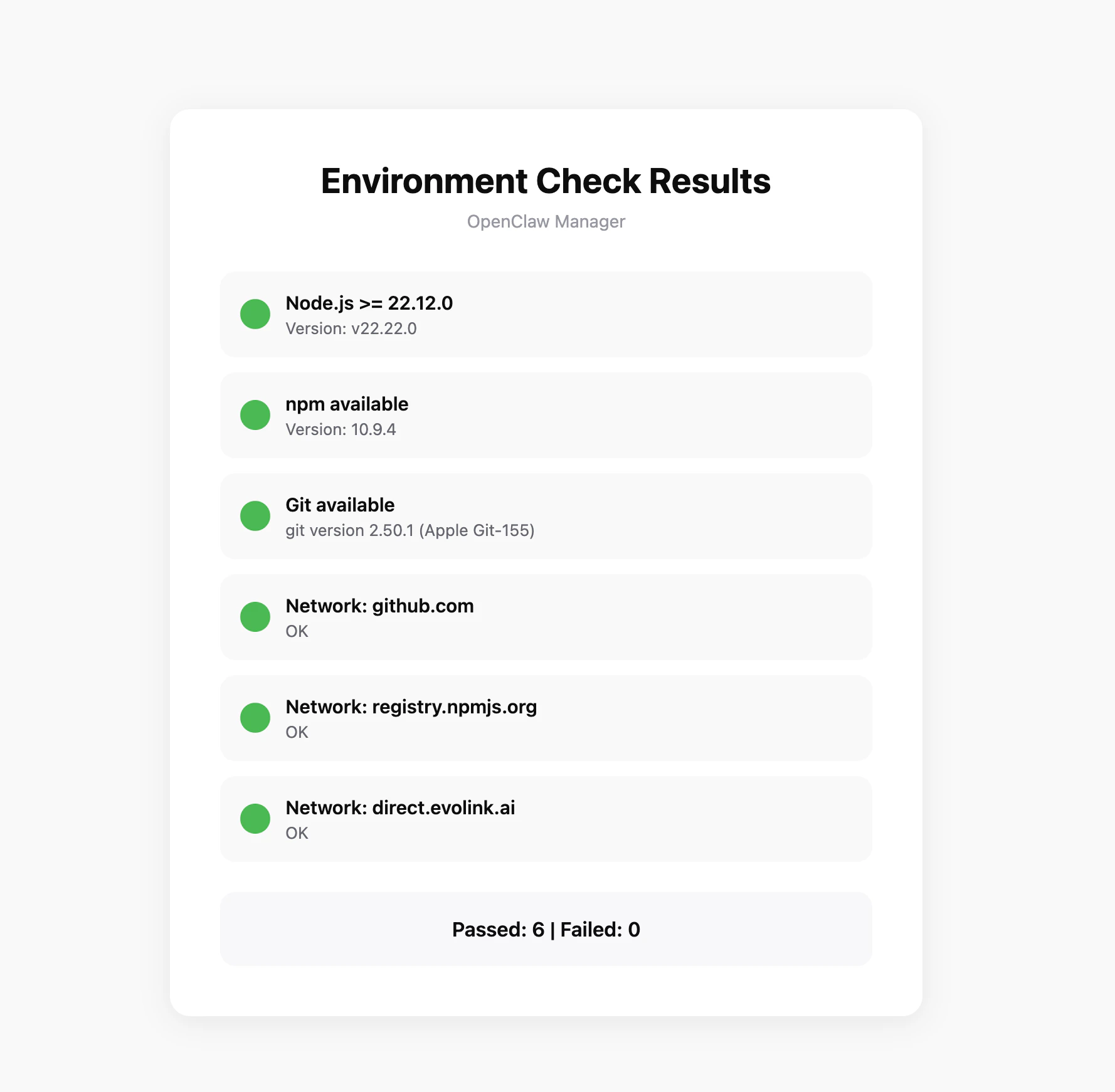

Vérification de l’Environnement Système (Optionnel)

Avant de commencer l’installation, il est recommandé d’exécuter l’outil de vérification de l’environnement pour vous assurer que votre système répond aux exigences d’OpenClaw.Télécharger l’Outil de Vérification

Téléchargez l’outil de vérification pour votre plateforme depuis GitHub Releases :| Plateforme | Nom du Fichier |

|---|---|

| Windows | openclaw-checker-win-x64.exe |

| macOS (Intel) | openclaw-checker-macos-x64 |

| macOS (Apple Silicon) | openclaw-checker-macos-arm64 |

| Linux | openclaw-checker-linux-x64 |

Éléments de Vérification

L’outil vérifiera automatiquement les éléments suivants :- ✅ Version de Node.js (nécessite >= 22.12.0)

- ✅ npm disponible

- ✅ Git disponible

- ✅ Connectivité réseau (github.com, npmjs.org, evolink.ai)

Prérequis

Avant de commencer la configuration, assurez-vous d’avoir terminé les étapes suivantes :1. Installer Node.js

OpenClaw est installé via npm et nécessite Node.js 22 ou supérieur.- Windows

- macOS

Visitez le site officiel de Node.js, téléchargez l’installateur Windows (fichier .msi) et exécutez-le.Après l’installation, ouvrez PowerShell pour vérifier :

Il est recommandé d’exécuter PowerShell en tant qu’administrateur pour éviter les problèmes de permissions lors de l’installation.

2. Obtenir la Clé API EvoLink

- Connectez-vous à la Console EvoLink

- Trouvez API Keys dans la console, cliquez sur “Créer une Nouvelle Clé” et copiez la clé générée

- La clé API commence généralement par

sk-, veuillez la conserver en sécurité

Étape 1 : Installer OpenClaw

Exécutez dans le terminal :Étape 2 : Configuration Initiale

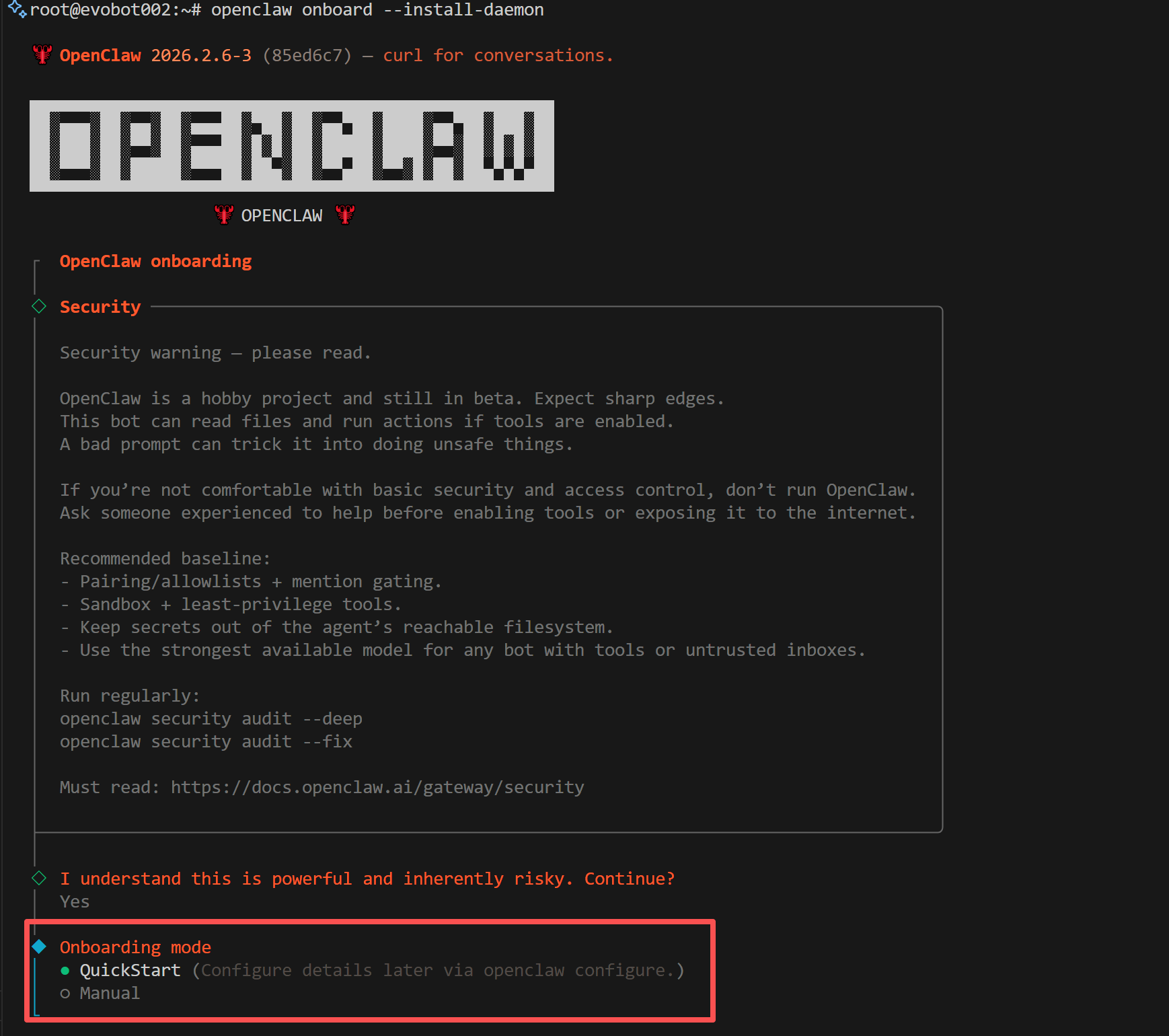

Exécutez la commande d’intégration. OpenClaw vous guidera à travers la configuration initiale et installera le service daemon :1. Confirmer l’Installation

Le système affichera un avis d’installation, confirmez pour continuer :

2. Sélectionner le Mode d’Installation

Le système vous demandera de sélectionner un mode d’installation, choisissez Quickstart :

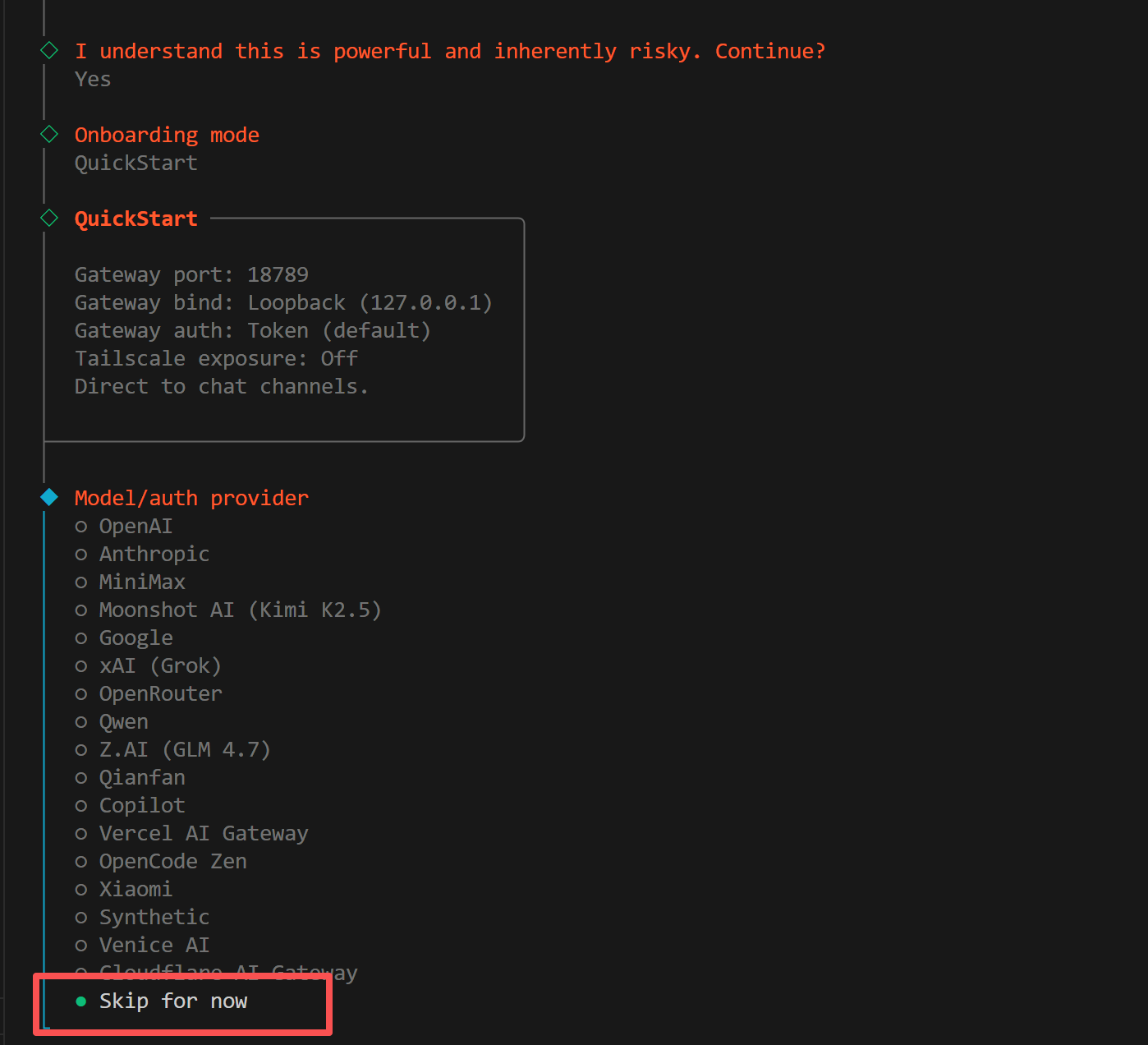

3. Sélectionner le Fournisseur

Le système vous demandera de sélectionner un fournisseur de modèles, choisissez Skip ici, nous configurerons EvoLink manuellement comme fournisseur personnalisé plus tard :

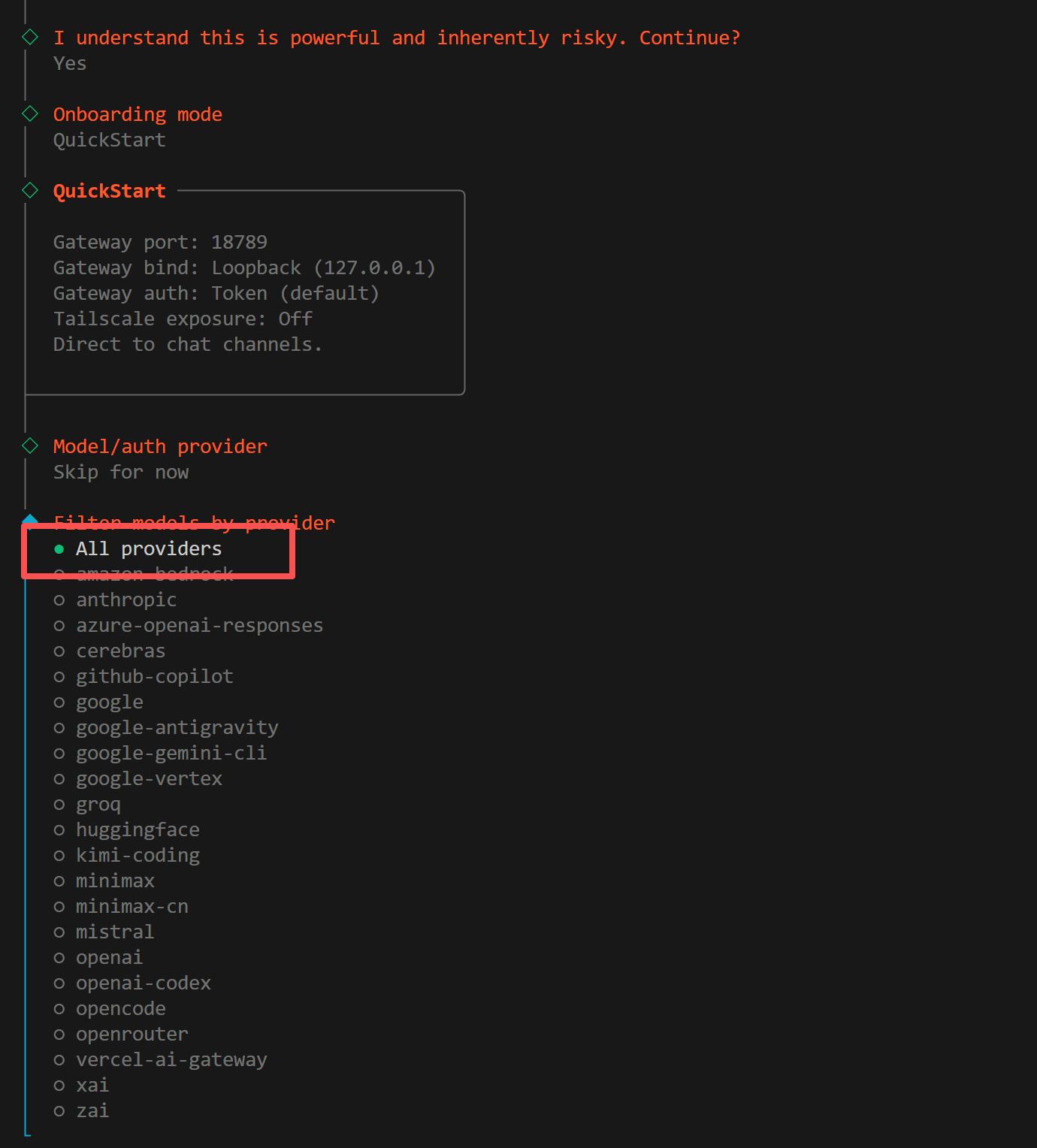

4. Sélectionner les Modèles

Le système vous demandera de sélectionner les modèles à activer, choisissez All :

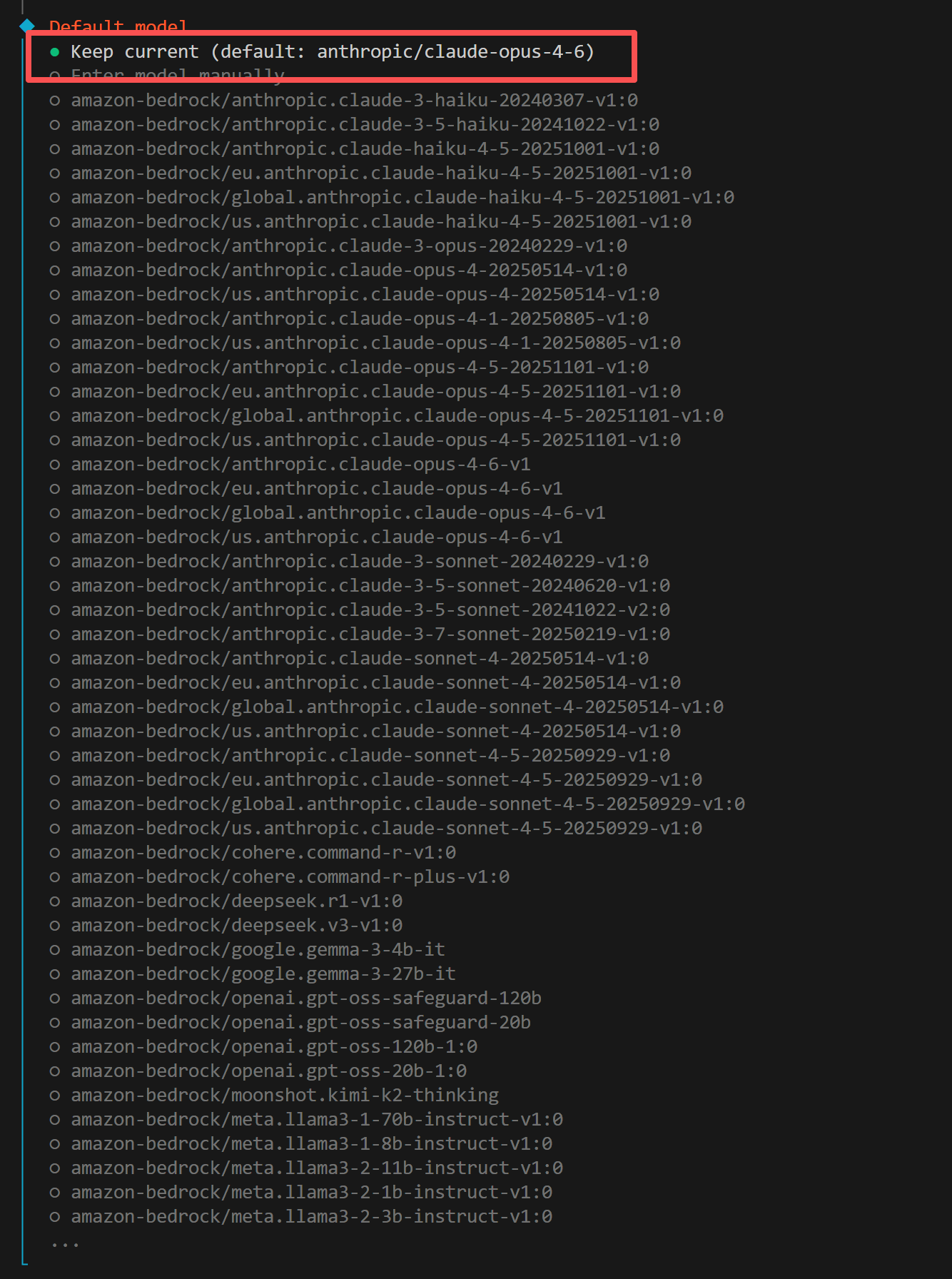

5. Sélectionner le Modèle par Défaut

Le système vous demandera de sélectionner le modèle par défaut, choisissez Keep current :

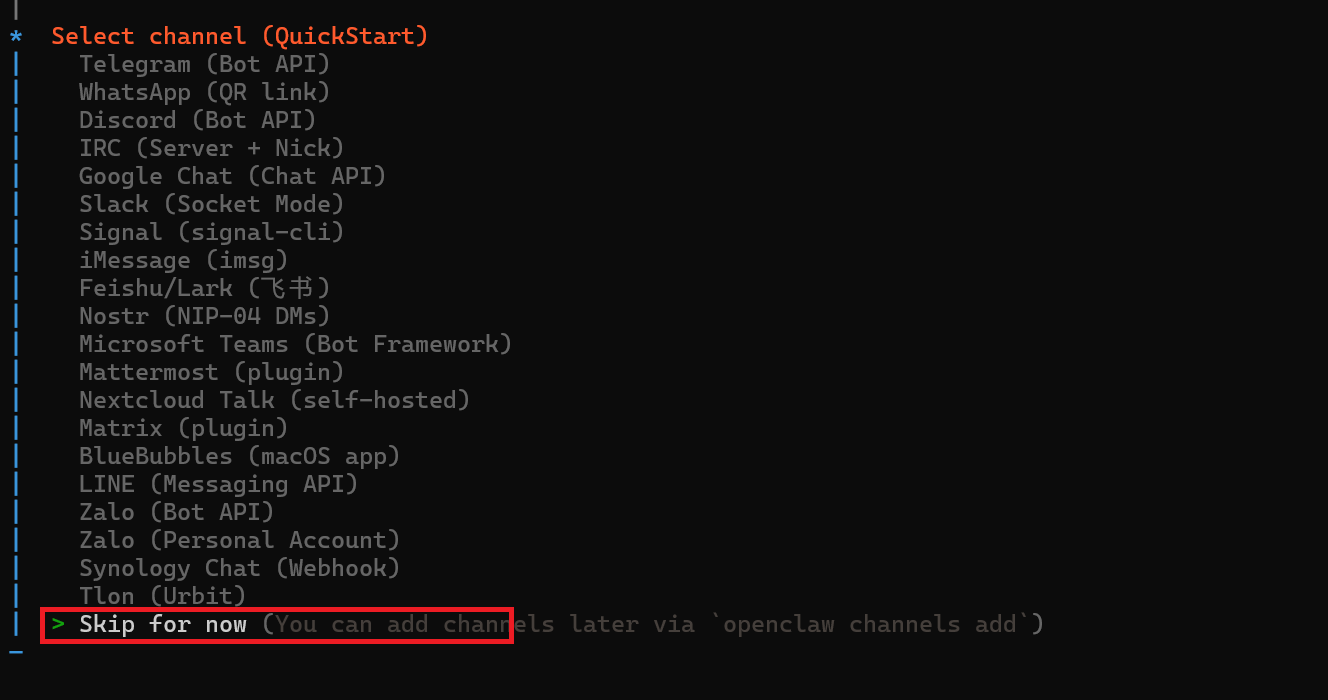

6. Sélectionner le Canal

Le système vous demandera de sélectionner un canal de chat. Il est recommandé de choisir Skip for now, vous pourrez ajouter des canaux plus tard :

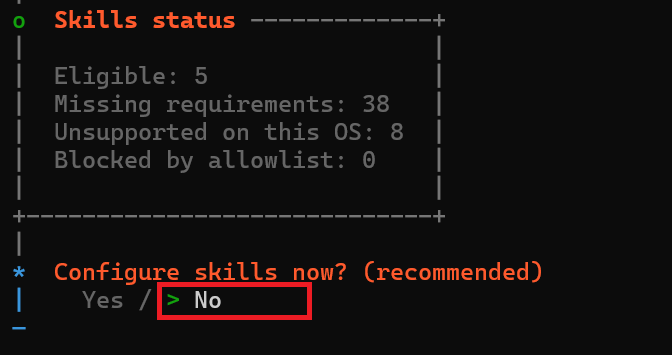

7. Configurer les Skills

Le système demandera si vous souhaitez configurer les Skills. Il est recommandé de choisir No, vous pourrez les ajouter plus tard :

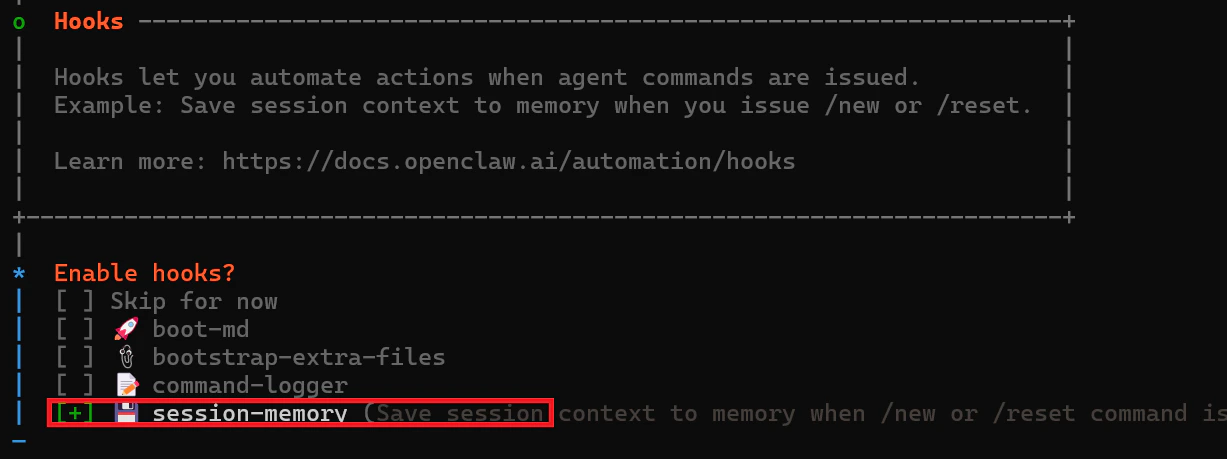

8. Activer les Hooks

Le système demandera si vous souhaitez activer les Hooks. Il est recommandé de choisir session-memory :

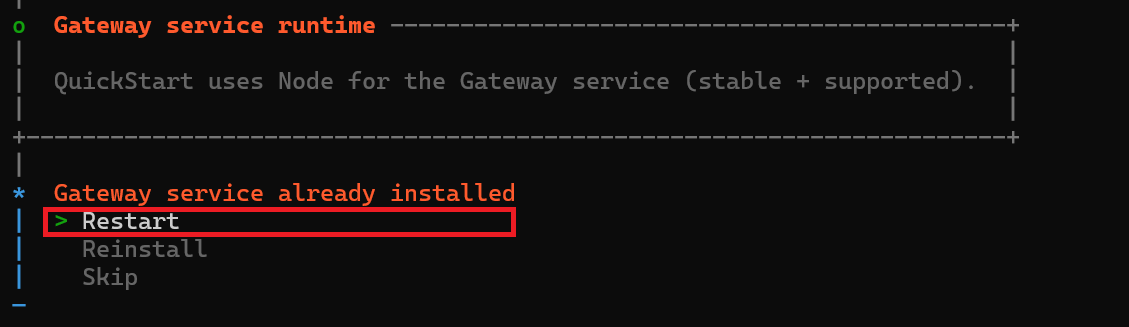

9. Redémarrer le Service Gateway

Le système indiquera que le service gateway est déjà installé, choisissez Restart :

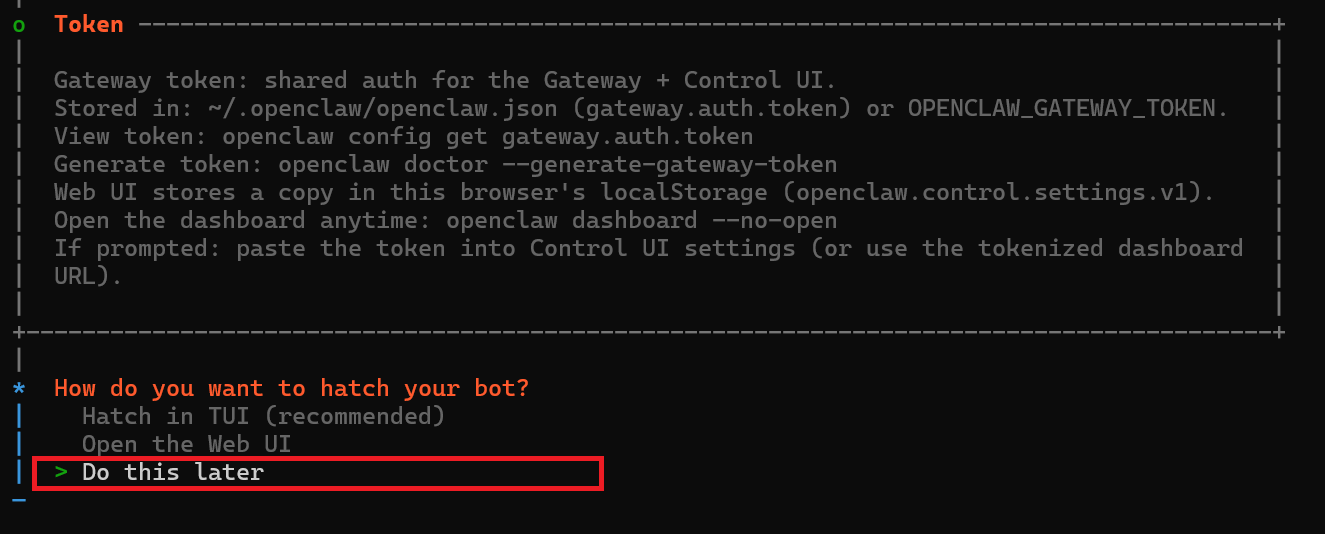

10. Lancer le Bot

Le système demandera comment lancer le bot. Il est recommandé de choisir Do this later :

Étape 3 : Configurer EvoLink API et Changement de Modèles

1. Localiser Deux Fichiers de Configuration (Important)

La configuration du modèle OpenClaw implique généralement deux fichiers :- Windows

- macOS

openclaw.json:%USERPROFILE%\.openclaw\openclaw.jsonmodels.json:%USERPROFILE%\.openclaw\agents\main\agent\models.json

2. Configurer les Fournisseurs de Modèles

Il est recommandé de configurer les fournisseurs suivants dansopenclaw.json (et de synchroniser avec models.json) :

Les ID de modèles ci-dessus sont des exemples. Veuillez utiliser les modèles réellement disponibles dans votre compte EvoLink.

3. Configurer le Modèle par Défaut (Prend en Charge le Changement Rapide)

Définissez le modèle par défaut dansagents.defaults. Nous recommandons d’utiliser le routage intelligent evolink/auto, qui sélectionne automatiquement un modèle adapté en fonction de la requête :

- Routage intelligent :

evolink-anthropic/evolink/auto(Recommandé) - Claude :

evolink-anthropic/claude-opus-4-6 - GPT :

evolink-openai/gpt-5.2 - Gemini :

evolink-google/gemini-3.1-pro-preview - Doubao :

evolink-openai/doubao-seed-2.0-mini

4. Changement Rapide vers les Modèles EvoLink (Recommandé)

Après avoir terminé la configuration du fournisseur, il est recommandé d’utiliser les commandes CLI pour changer de modèle au lieu de modifier manuellement le JSON :Si

models list --provider evolink-openai n’affiche pas vos modèles attendus, vérifiez si openclaw.json et models.json ont tous deux configuré le fournisseur correspondant.5. Redémarrer et Vérifier

Redémarrez la passerelle après la configuration :Commandes Courantes

| Commande | Description |

|---|---|

openclaw gateway status | Vérifier l’état d’exécution de la passerelle |

openclaw gateway restart | Redémarrer le service de passerelle |

openclaw gateway stop | Arrêter le service de passerelle |

openclaw gateway start | Démarrer le service de passerelle |

openclaw logs --follow | Afficher les journaux de la passerelle en temps réel |

openclaw plugins list | Afficher les plugins installés |

Dépannage

| Problème | Solution |

|---|---|

| L’installation npm échoue | Windows : Exécuter PowerShell en tant qu’administrateur ; macOS : Ajouter sudo avant la commande |

| Fichier de configuration introuvable | Confirmez que le processus d’intégration est terminé, vérifiez si le répertoire ~/.openclaw/ existe |

| La passerelle ne démarre pas | Vérifiez si le port est occupé, utilisez openclaw gateway status pour voir les erreurs détaillées |

| Clé API invalide | Confirmez que la clé API a été copiée correctement, vérifiez les espaces ou guillemets supplémentaires |

| La configuration du modèle n’est pas effective | Vérifiez à la fois openclaw.json et models.json pour la cohérence (models.json peut remplacer) |

Gemini renvoie Forbidden (403) | Vérifiez si models.providers.evolink-google.baseUrl est https://direct.evolink.ai/v1beta (doit inclure /v1beta) |

| L’ancien modèle est toujours utilisé après le changement | Exécutez openclaw models status --plain pour confirmer le modèle actuel, redémarrez avec openclaw gateway restart si nécessaire |

Prochaines Étapes

L’installation d’OpenClaw et la configuration d’EvoLink API sont terminées. Ensuite, vous pouvez :- Configurer le Canal Telegram : Consultez la documentation OpenClaw + Telegram

- Configurer le Canal Feishu : Consultez la documentation OpenClaw + Feishu

- Utiliser l’Outil d’Installation Automatique : Consultez la documentation Installation Automatique d’OpenClaw