Documentation Index

Fetch the complete documentation index at: https://docs.evolink.ai/llms.txt

Use this file to discover all available pages before exploring further.

Übersicht

CodeBuddy und WorkBuddy sind von Tencent Cloud entwickelte KI-Tools, die die Integration benutzerdefinierter KI-Modelle übermodels.json-Konfigurationsdateien unterstützen.

Durch die Integration mit der EvoLink API können Sie direkt verschiedene von EvoLink bereitgestellte KI-Modellfunktionen nutzen.

CodeBuddy und WorkBuddy verwenden dieselbe Konfigurationsmethode. Diese Dokumentation gilt für beide.

Voraussetzungen

EvoLink API-Schlüssel erhalten

- Melden Sie sich in der EvoLink-Konsole an

- Finden Sie API-Schlüssel in der Konsole, klicken Sie auf die Schaltfläche “Neuen Schlüssel erstellen” und kopieren Sie den generierten Schlüssel

- Der API-Schlüssel beginnt normalerweise mit

sk-, bitte bewahren Sie ihn sicher auf

Konfigurationsschritte

1. Konfigurationsdatei öffnen

CodeBuddy:~/.codebuddy/models.json

WorkBuddy: ~/.workbuddy/models.json

2. Evolink-Modellkonfiguration hinzufügen

Bearbeiten Sie die Dateimodels.json und fügen Sie die folgende Konfiguration hinzu:

Derzeit wird nur die API-Integration im OpenAI SDK-Format unterstützt.

Weitere verfügbare Modelle

Zusätzlich zu den obigen Beispielen können Sie die folgenden Modelle hinzufügen (gleiches Konfigurationsformat, fügen Sie das Präfix “Evolink ” zum Namensfeld hinzu): GPT-Serie:gpt-5.2- Evolink GPT-5.2gpt-5.1- Evolink GPT-5.1gpt-5.1-chat- Evolink GPT-5.1 Chatgpt-5.1-thinking- Evolink GPT-5.1 Thinking

gemini-2.5-pro- Evolink Gemini 2.5 Progemini-2.5-flash- Evolink Gemini 2.5 Flashgemini-3-pro-preview- Evolink Gemini 3.0 Progemini-3-flash-preview- Evolink Gemini 3.0 Flash

doubao-seed-2.0-pro- Evolink Doubao Seed 2.0 Prodoubao-seed-2.0-lite- Evolink Doubao Seed 2.0 Litedoubao-seed-2.0-code- Evolink Doubao Seed 2.0 Code

kimi-k2-thinking- Evolink Kimi K2 Thinkingkimi-k2-thinking-turbo- Evolink Kimi K2 Thinking Turbo

3. Speichern und neu starten

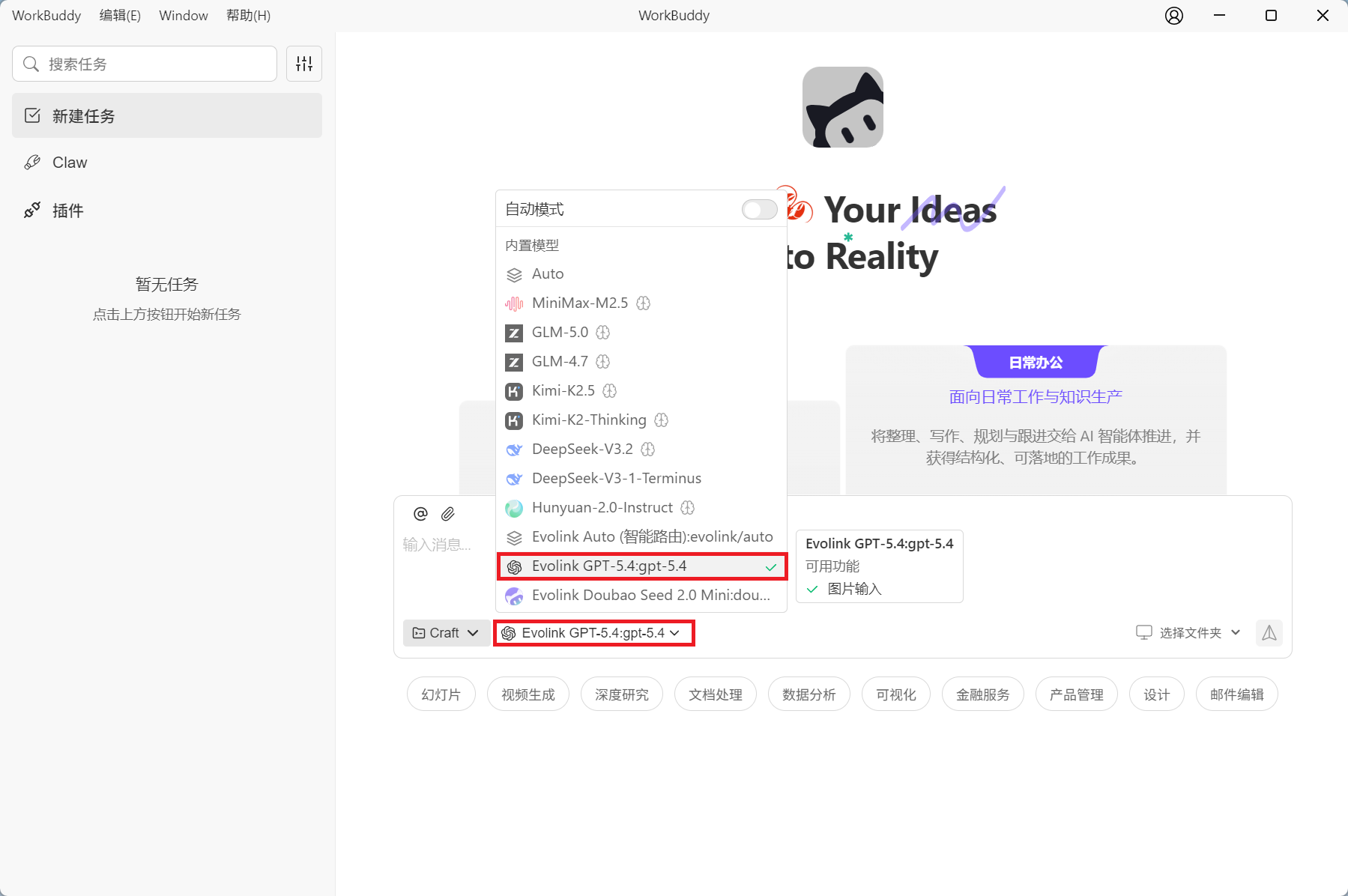

Nach dem Speichern der Konfigurationsdatei erkennt das Tool automatisch Konfigurationsänderungen und lädt neu (1 Sekunde Entprellverzögerung). Nach Abschluss der Konfiguration können Sie alle konfigurierten Evolink-Modelle im Dropdown-Menü zur Modellauswahl sehen:

Evolink Auto Intelligentes Routing verwenden

Was ist Evolink Auto?

Evolink Auto ist eine intelligente Modell-Routing-Funktion, die automatisch das am besten geeignete KI-Modell basierend auf Ihrem Anforderungsinhalt auswählt.Hauptvorteile

- Intelligente Anpassung: Analysiert automatisch den Anforderungsinhalt und wählt das am besten geeignete Modell aus

- Kostenoptimierung: Priorisiert kostengünstige Modelle bei gleichzeitiger Qualitätssicherung

- Lastausgleich: Verteilt Anfragen automatisch auf mehrere Modelle, um die Systemstabilität zu verbessern

- Transparent: Gibt den tatsächlich verwendeten Modellnamen in der Antwort zurück

Verwendung

Wählen Sie “Evolink Auto (Intelligentes Routing)” im Dropdown-Menü zur Modellauswahl.Verfügbare Modellliste einschränken

Wenn Sie nur bestimmte Modelle im Dropdown-Menü anzeigen möchten, können Sie das FeldavailableModels verwenden:

FAQ

1. Wo befindet sich die Konfigurationsdatei?

CodeBuddy:- macOS/Linux:

~/.codebuddy/models.json - Windows:

C:\Users\<Benutzername>\.codebuddy\models.json

- macOS/Linux:

~/.workbuddy/models.json - Windows:

C:\Users\<Benutzername>\.workbuddy\models.json

2. Wird die Konfiguration auf Projektebene unterstützt?

Ja. Zusätzlich zur Konfiguration auf Benutzerebene können Sie Konfigurationsdateien im Projektstammverzeichnis erstellen: CodeBuddy:<Projektstammverzeichnis>/.codebuddy/models.json

WorkBuddy: <Projektstammverzeichnis>/.workbuddy/models.json

Die Konfiguration auf Projektebene hat eine höhere Priorität als die Konfiguration auf Benutzerebene. Es wird empfohlen, globale Modelle auf Benutzerebene und projektspezifische Modelle auf Projektebene zu konfigurieren.

3. Was tun, wenn die Konfiguration nicht funktioniert?

- Überprüfen Sie, ob das JSON-Format korrekt ist (verwenden Sie einen JSON-Validator)

- Bestätigen Sie, dass der API-Schlüssel korrekt ist

- Versuchen Sie, die Anwendung neu zu starten