Documentation Index

Fetch the complete documentation index at: https://docs.evolink.ai/llms.txt

Use this file to discover all available pages before exploring further.

Descripción general

CodeBuddy y WorkBuddy son herramientas de IA lanzadas por Tencent Cloud que admiten la integración de modelos de IA personalizados a través de archivos de configuraciónmodels.json.

Al integrarlos con la API de EvoLink, puede utilizar directamente varias capacidades de modelos de IA proporcionadas por EvoLink.

CodeBuddy y WorkBuddy utilizan el mismo método de configuración. Esta documentación se aplica a ambos.

Requisitos previos

Obtener la clave API de EvoLink

- Inicie sesión en la Consola de EvoLink

- Encuentre las claves API en la consola, haga clic en el botón “Crear nueva clave” y copie la clave generada

- La clave API generalmente comienza con

sk-, guárdela de forma segura

Pasos de configuración

1. Abrir el archivo de configuración

CodeBuddy:~/.codebuddy/models.json

WorkBuddy: ~/.workbuddy/models.json

2. Agregar configuración del modelo Evolink

Edite el archivomodels.json y agregue la siguiente configuración:

Actualmente solo se admite la integración de API en formato OpenAI SDK.

Más modelos disponibles

Además de los ejemplos anteriores, puede agregar los siguientes modelos (mismo formato de configuración, agregue el prefijo “Evolink ” al campo name): Serie GPT:gpt-5.2- Evolink GPT-5.2gpt-5.1- Evolink GPT-5.1gpt-5.1-chat- Evolink GPT-5.1 Chatgpt-5.1-thinking- Evolink GPT-5.1 Thinking

gemini-2.5-pro- Evolink Gemini 2.5 Progemini-2.5-flash- Evolink Gemini 2.5 Flashgemini-3-pro-preview- Evolink Gemini 3.0 Progemini-3-flash-preview- Evolink Gemini 3.0 Flash

doubao-seed-2.0-pro- Evolink Doubao Seed 2.0 Prodoubao-seed-2.0-lite- Evolink Doubao Seed 2.0 Litedoubao-seed-2.0-code- Evolink Doubao Seed 2.0 Code

kimi-k2-thinking- Evolink Kimi K2 Thinkingkimi-k2-thinking-turbo- Evolink Kimi K2 Thinking Turbo

3. Guardar y reiniciar

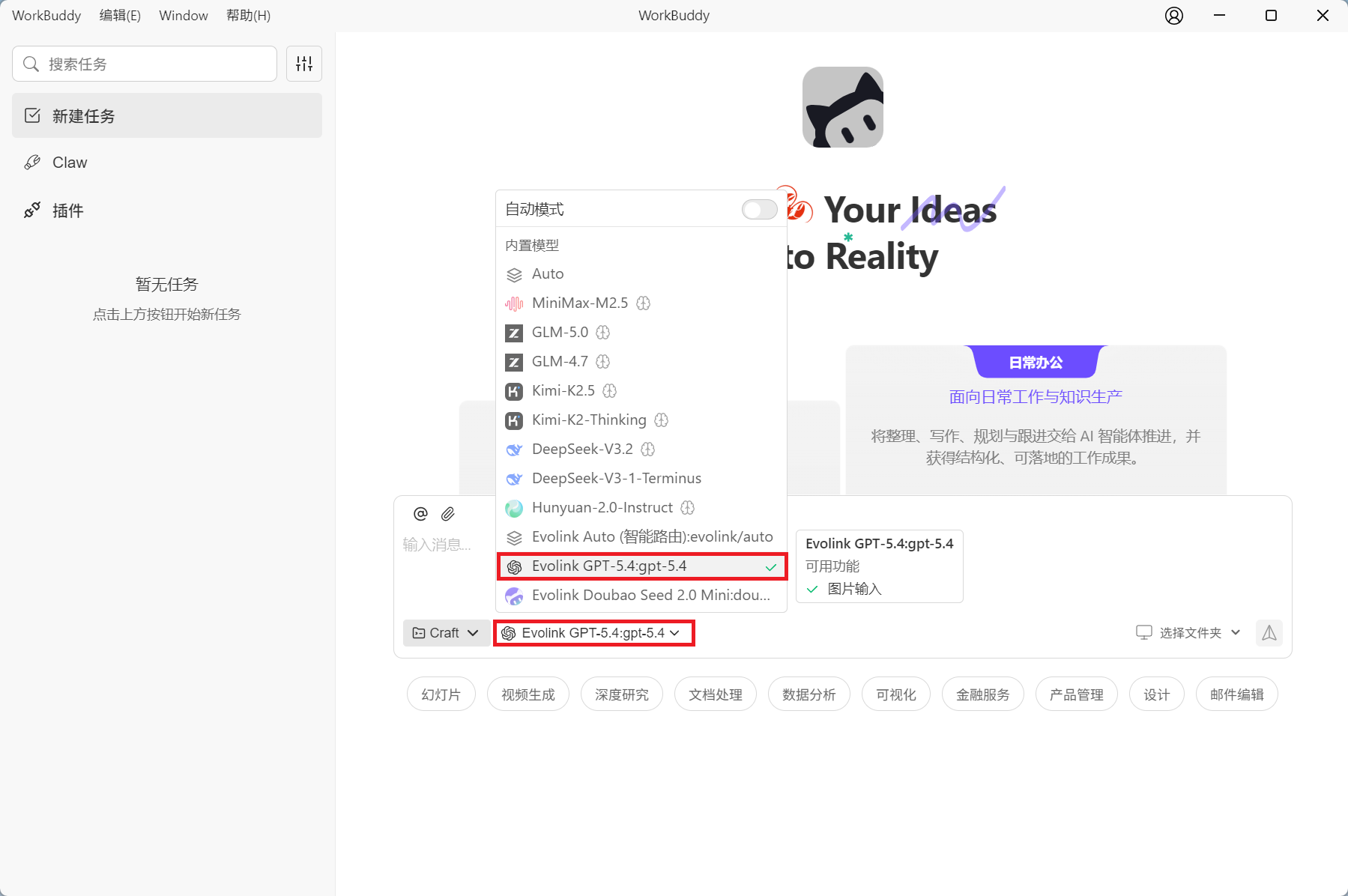

Después de guardar el archivo de configuración, la herramienta detectará automáticamente los cambios de configuración y se recargará (retraso de rebote de 1 segundo). Una vez completada la configuración, puede ver todos los modelos Evolink configurados en el menú desplegable de selección de modelo:

Usar el enrutamiento inteligente Evolink Auto

¿Qué es Evolink Auto?

Evolink Auto es una función de enrutamiento de modelo inteligente que selecciona automáticamente el modelo de IA más adecuado según el contenido de su solicitud.Ventajas principales

- Coincidencia inteligente: Analiza automáticamente el contenido de la solicitud y selecciona el modelo más adecuado

- Optimización de costos: Prioriza modelos rentables mientras garantiza la calidad

- Equilibrio de carga: Distribuye automáticamente las solicitudes entre múltiples modelos para mejorar la estabilidad del sistema

- Transparente: Devuelve el nombre del modelo realmente utilizado en la respuesta

Uso

Seleccione “Evolink Auto (Enrutamiento Inteligente)” en el menú desplegable de selección de modelo.Limitar la lista de modelos disponibles

Si solo desea mostrar modelos específicos en el menú desplegable, puede usar el campoavailableModels:

Preguntas frecuentes

1. ¿Dónde está el archivo de configuración?

CodeBuddy:- macOS/Linux:

~/.codebuddy/models.json - Windows:

C:\Users\<nombre_usuario>\.codebuddy\models.json

- macOS/Linux:

~/.workbuddy/models.json - Windows:

C:\Users\<nombre_usuario>\.workbuddy\models.json

2. ¿Se admite la configuración a nivel de proyecto?

Sí. Además de la configuración a nivel de usuario, puede crear archivos de configuración en el directorio raíz del proyecto: CodeBuddy:<directorio_raíz_proyecto>/.codebuddy/models.json

WorkBuddy: <directorio_raíz_proyecto>/.workbuddy/models.json

La configuración a nivel de proyecto tiene mayor prioridad que la configuración a nivel de usuario. Se recomienda configurar modelos globales a nivel de usuario y modelos específicos del proyecto a nivel de proyecto.

3. ¿Qué hacer si la configuración no funciona?

- Verifique si el formato JSON es correcto (use un validador JSON)

- Confirme que la clave API sea correcta

- Intente reiniciar la aplicación