Documentation Index

Fetch the complete documentation index at: https://docs.evolink.ai/llms.txt

Use this file to discover all available pages before exploring further.

Aperçu

CodeBuddy et WorkBuddy sont des outils d’IA lancés par Tencent Cloud qui prennent en charge l’intégration de modèles d’IA personnalisés via des fichiers de configurationmodels.json.

En les intégrant avec l’API EvoLink, vous pouvez utiliser directement diverses capacités de modèles d’IA fournies par EvoLink.

CodeBuddy et WorkBuddy utilisent la même méthode de configuration. Cette documentation s’applique aux deux.

Prérequis

Obtenir la clé API EvoLink

- Connectez-vous à la Console EvoLink

- Trouvez les clés API dans la console, cliquez sur le bouton “Créer une nouvelle clé” et copiez la clé générée

- La clé API commence généralement par

sk-, veuillez la conserver en sécurité

Étapes de configuration

1. Ouvrir le fichier de configuration

CodeBuddy:~/.codebuddy/models.json

WorkBuddy: ~/.workbuddy/models.json

2. Ajouter la configuration du modèle Evolink

Modifiez le fichiermodels.json et ajoutez la configuration suivante:

Actuellement, seule l’intégration API au format OpenAI SDK est prise en charge.

Plus de modèles disponibles

En plus des exemples ci-dessus, vous pouvez ajouter les modèles suivants (même format de configuration, ajoutez le préfixe “Evolink ” au champ name): Série GPT:gpt-5.2- Evolink GPT-5.2gpt-5.1- Evolink GPT-5.1gpt-5.1-chat- Evolink GPT-5.1 Chatgpt-5.1-thinking- Evolink GPT-5.1 Thinking

gemini-2.5-pro- Evolink Gemini 2.5 Progemini-2.5-flash- Evolink Gemini 2.5 Flashgemini-3-pro-preview- Evolink Gemini 3.0 Progemini-3-flash-preview- Evolink Gemini 3.0 Flash

doubao-seed-2.0-pro- Evolink Doubao Seed 2.0 Prodoubao-seed-2.0-lite- Evolink Doubao Seed 2.0 Litedoubao-seed-2.0-code- Evolink Doubao Seed 2.0 Code

kimi-k2-thinking- Evolink Kimi K2 Thinkingkimi-k2-thinking-turbo- Evolink Kimi K2 Thinking Turbo

3. Enregistrer et redémarrer

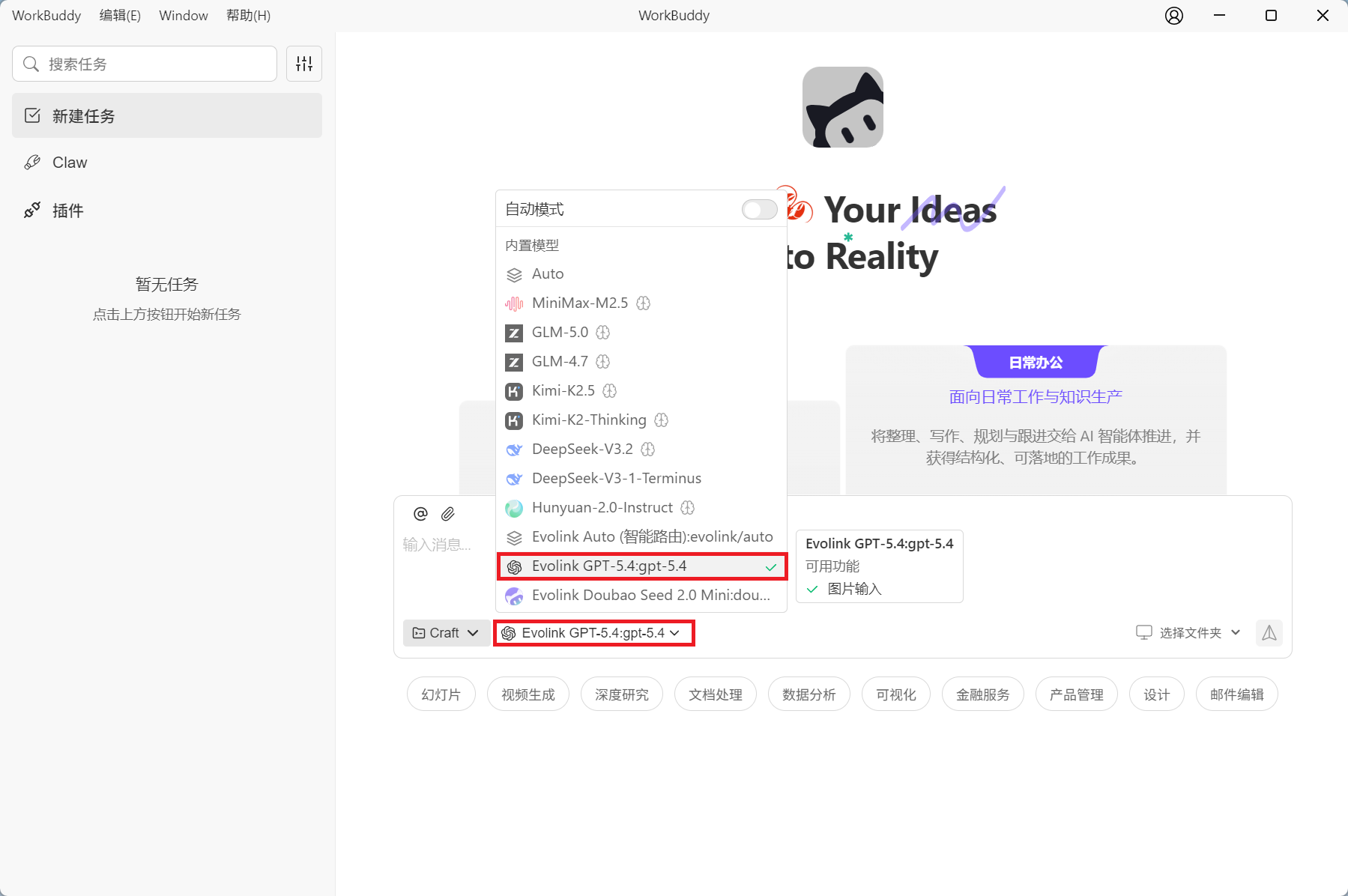

Après avoir enregistré le fichier de configuration, l’outil détectera automatiquement les modifications de configuration et rechargera (délai d’anti-rebond de 1 seconde). Une fois la configuration terminée, vous pouvez voir tous les modèles Evolink configurés dans le menu déroulant de sélection de modèle:

Utiliser le routage intelligent Evolink Auto

Qu’est-ce qu’Evolink Auto?

Evolink Auto est une fonctionnalité de routage de modèle intelligent qui sélectionne automatiquement le modèle d’IA le plus approprié en fonction du contenu de votre demande.Avantages principaux

- Correspondance intelligente: Analyse automatiquement le contenu de la demande et sélectionne le modèle le plus approprié

- Optimisation des coûts: Privilégie les modèles rentables tout en garantissant la qualité

- Équilibrage de charge: Distribue automatiquement les demandes entre plusieurs modèles pour améliorer la stabilité du système

- Transparent: Renvoie le nom du modèle réellement utilisé dans la réponse

Utilisation

Sélectionnez “Evolink Auto (Routage Intelligent)” dans le menu déroulant de sélection de modèle.Limiter la liste des modèles disponibles

Si vous souhaitez afficher uniquement des modèles spécifiques dans le menu déroulant, vous pouvez utiliser le champavailableModels:

FAQ

1. Où se trouve le fichier de configuration?

CodeBuddy:- macOS/Linux:

~/.codebuddy/models.json - Windows:

C:\Users\<nom_utilisateur>\.codebuddy\models.json

- macOS/Linux:

~/.workbuddy/models.json - Windows:

C:\Users\<nom_utilisateur>\.workbuddy\models.json

2. La configuration au niveau du projet est-elle prise en charge?

Oui. En plus de la configuration au niveau de l’utilisateur, vous pouvez créer des fichiers de configuration dans le répertoire racine du projet: CodeBuddy:<répertoire_racine_projet>/.codebuddy/models.json

WorkBuddy: <répertoire_racine_projet>/.workbuddy/models.json

La configuration au niveau du projet a une priorité plus élevée que la configuration au niveau de l’utilisateur. Il est recommandé de configurer les modèles globaux au niveau de l’utilisateur et les modèles spécifiques au projet au niveau du projet.

3. Que faire si la configuration ne fonctionne pas?

- Vérifiez si le format JSON est correct (utilisez un validateur JSON)

- Confirmez que la clé API est correcte

- Essayez de redémarrer l’application